چگونه مدیران امنیت سایبری میتوانند با احتیاط از مزایای ChatGPT بهرهمند شوند؟

ChatGPT یک ابزار قدرتمند جدید است که میتواند ارزش زیادی به شرکتها اضافه کند، اما همچنین میتواند خسارات امنیتی بزرگی به بار آورد. Rodman Ramezanian، رهبر جهانی تهدیدات ابری در Skyhigh Security توضیح میدهد که چگونه مسئولان امنیت سایبری میتوانند از ChatGPT بهرهمند شوند – و چرا با این حال باید با احتیاط عمل کنند.

چتبات هوش مصنوعی ChatGPT در مدت زمان کوتاهی به یکی از جذابترین، محبوبترین، و البته بحثبرانگیزترین سرویسهای ابری تبدیل شده است. این چتبات تنها دو ماه زمان نیاز داشت تا به مرز جادوی 100 میلیون کاربر فعال ماهانه برسد. در ارتباطات تجاری نیز ChatGPT به سرعت جای خود را باز کرده است: دادههای تلهمتری جهانی Skyhigh Security نشان میدهند که اکنون یک میلیون کاربر از ChatGPT در زیرساختهای IT شرکت خود استفاده میکنند. این ربات مبتنی بر هوش مصنوعی در زمینههای مختلف از انجام تکالیف تا نوشتن مقالات فنی و گزارشهای تجاری مهم بهکار گرفته میشود. امکانات به نظر بیپایان میرسند.

خطرات فناوریهای جدید

هرچند این فناوری جدید با امکانات بیپایان خود هیجانانگیز و مفید است، اما مسئولان امنیتی شرکتها باید به خاطر افزایش سریع تعداد دسترسیها به دقت توجه کنند. زیرا مانند هر ابزار جدیدی، ChatGPT نیز مجموعهای از خطرات را به همراه دارد – و میتواند توسط افراد مخرب برای انجام حملات هدفمند استفاده شود. نمونه عملی از چنین سوءاستفادهای از ربات، نوشتن پیامهای فیشینگ دقیق در موضوعات مختلف است: هرچند که ChatGPT از نوشتن مستقیم یک ایمیل فیشینگ خودداری میکند – سیستم فیلتری که برای بررسی سطحی استفاده اخلاقی تعبیه شده است، این کار را انجام میدهد. اما اگر مهاجم کمتر تهاجمی عمل کند و مثلاً درخواست یک قالب ایمیل برای یک رویداد کاری بدهد، ChatGPT به راحتی به خدمت گرفته میشود. این قالب میتواند بدون زحمت زیادی پایهای محکم برای ایمیلهای فیشینگ فراهم کند.

با این حال، میتوان استدلال کرد که هکرها مدتهاست قادر به خودکارسازی حملات و سوءاستفاده از انواع مختلف هوش مصنوعی/یادگیری ماشین برای اهداف خود هستند. اما اگر این فکر را ادامه دهیم، به سرعت به این نتیجه میرسیم که ChatGPT میتواند کار را برای افراد مخرب به طور قابل توجهی تسهیل کند و به آنها امکان میدهد تا حملات شخصیسازی شده را در مقیاس بزرگ انجام دهند.

از سوی دیگر، chat.openai.com در هر زمان برای همگان قابل دسترسی است. بنابراین، در آینده نه تنها از هکرهای حرفهای – که با اکسپلویتهای پیچیده و نقاط ضعف سیستم آشنا هستند – بلکه از مبتدیان و نوجوانان بدون دانش قابل توجه IT نیز میتواند خطراتی برای معماری IT ایجاد کند. تئوری این است که حتی برای یک دانشآموز که ChatGPT را صرفاً برای اهداف آموزشی استفاده میکند، امکان آغاز حملات سرریز بافر بر روی مرورگرهای وب رایج وجود دارد.

Skyhigh Security به شرکتها در ارزیابی ریسک کمک میکند

این مثال نشان میدهد که سوءاستفاده از چتبات توسط هکرها چقدر آسان و محتمل است. برای مسئولان امنیتی، بقا در دنیا و پیگیری توسعههای جدید در حوزه هوش مصنوعی ضروری است. مثل هر فناوری دیگر، باید ابتدا خطرات آن را به دقت شناخت تا بتوان از آنها محافظت کرد.

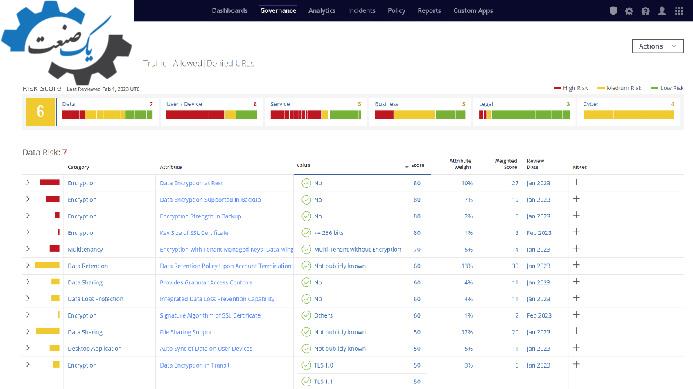

یک نمای کلی از دنیای پیچیده و هر چه بیشتر گسترده خدمات ابری مبتنی بر هوش مصنوعی را فهرست امنیت ابری Skyhigh به شرکتها ارائه میدهد: در این فهرست جامع، کارشناسان ما در حال حاضر بیش از 40,000 سرویس SaaS، PaaS و IaaS را تحلیل میکنند که فقط 500 مورد آن در دسته خدمات ابری مبتنی بر هوش مصنوعی قرار میگیرند. ChatGPT یکی از این خدمات است.

در چارچوب این فهرست، خدمات ابری با یک رتبهبندی امنیتی شفاف طبقهبندی میشوند، که به شرکتها این امکان را میدهد تا به راحتی ارزیابی کنند که آیا میتوانند بهطور ایمن از یک سرویس خاص استفاده کنند یا خیر. برای این منظور، ما میانگین ارزش 75 ویژگی ریسک را که با همکاری اتحادیه امنیت ابری (CSA) توسعه داده شده، محاسبه میکنیم. این طرح ارزیابی شامل دستهبندیهای داده، کاربران/دستگاهها، خدمات، شرکتها، وضعیت قانونی و سایبری است که هر کدام با مقداری بین 1 تا 9 ارزیابی میشوند. این ارزیابی به شرکتها نقطه شروع خوبی برای تعریف سیاستهای حاکمیت ابری برای کارکنانشان ارائه میدهد.

مسئولان امنیتی باید برای هر سرویس به سؤالات زیر پاسخ دهند:

- آیا کارمندی به سایت دسترسی پیدا کرده/استفاده کرده است؟ اگر بله، چند بار این اتفاق افتاده و چه کسی دقیقاً دسترسی داشته است؟

- آیا از طریق زیرساخت وب و ابری شرکت به سرویس دسترسی پیدا شده است؟

- و اگر به یکی از دو سؤال قبلی با «بله» پاسخ داده شد، چه میزان داده بین شرکت و این سرویس تبادل شده است؟

بر اساس این ارزیابی، تیمهای امنیتی میتوانند اقدامات مشخصی برای محافظت از دستگاهها، محیطهای وب و ابری آغاز کنند – و مثلاً تصمیم بگیرند که آیا دسترسی به این سرویس باید محدود یا به طور کامل مسدود شود. همچنین میتوان بسیاری از اقدامات امنیتی دیگر را آغاز کرد: به عنوان مثال، با هشدار به کاربران که سرویسی که به آن دسترسی پیدا میکنند به عنوان مشکوک طبقهبندی شده است یا محدود کردن میزان دادهای که میتوانند بارگذاری کنند.

خلاصه

که هوش مصنوعی و یادگیری ماشین به امنیت سایبری ارزش میدهند، شکی نیست. این فناوریها تحلیل ترافیک دادهها در زمان واقعی را به سطحی جدید میبرند زیرا به سرعت ناهنجاریها را تشخیص میدهند – و اغلب قبل از ایجاد آسیب آنها را متوقف میکنند. همچنین ChatGPT به تیمهای امنیت سایبری مزایای جالبی ارائه میدهد: میتوان از این چتبات قدرتمند برای جمعآوری حجم عظیمی از دادهها به منظور تسهیل تستهای فشار سیستم یا انجام تستهای فازینگ در توسعه نرمافزار استفاده کرد. از نظر تئوری، حتی ممکن است حملات خصمانه به یک سیستم را برای مقاصد آموزشی شبیهسازی کرد.

با وجود این مزایا – و اگرچه ChatGPT هنوز در مراحل ابتدایی خود است – اما در مورد استفاده از آن، سوالات اخلاقی بسیاری مطرح است: به نظر میرسد تنها مساله زمان است که هکرها این ربات را به نفع خود استفاده کرده و برای اهداف ناپسند به کار گیرند. به همین دلیل، باید با دقت این فناوری جوان را زیر نظر داشت تا اطمینان حاصل شود که توازن بین سود و خطرات در جهت نادرست نچرخد.